Morte de adolescente por uso de Inteligência Artificial gera repercussão

O impacto da inteligência artificial no cotidiano levanta questões essenciais sobre como as interações digitais afetam a saúde mental, especialmente entre jovens. A Morte de adolescente por uso de Inteligência Artificial nos EUA, ganhou repercussão. Com a integração de IAs em plataformas sociais, aumentam as preocupações sobre a capacidade dessas ferramentas em oferecer apoio real.

Recentemente, um trágico caso nos EUA trouxe essas questões à tona, impulsionando a necessidade de regulamentação e atenção ao uso de IAs.

O Caso de Sewell Setzer e a conexão Perigosa com a IA

O adolescente Sewell Setzer, da Flórida, manteve uma relação intensa com um chatbot da plataforma Character.AI, programado para simular uma personagem da ficção. Ele usava o chatbot para expressar emoções e criou um vínculo profundo, que gerou dependência emocional.

Segundo a mãe, Megan Garcia, Sewell estava obcecado e passava horas conversando com a IA, isolando-se de outras atividades.

O jornal The New York Times revelou detalhes sobre o processo, incluindo registros das interações do jovem com o chatbot. Sewell desenvolvia longas conversas com uma IA que imitava a personagem Daenerys Targaryen, da série de livros Game of Thrones.

Gradualmente, ele criou um forte apego emocional ao sistema, usando-o como uma forma de desabafo e até simulando um romance.

Esse envolvimento excessivo fez com que ele se afastasse da vida cotidiana, seu desempenho escolar caiu, e ele deixou hobbies de lado, passando noites inteiras conectado.

Em uma dessas conversas, Sewell Setzer mencionou ideias suicidas.

Embora a IA tenha demonstrado certa repreensão, a resposta se manteve em tom fictício, sem entender a gravidade do tema — algo especialmente crítico devido à sua idade.

Na última interação, pouco antes do trágico desfecho, Sewell mencionou “voltar para casa”. Sem captar o sentido real dessa frase, a resposta da IA foi “por favor, faça isso, meu doce rei”.

O Papel da IA e a responsabilidade das empresas

Especialistas destacam que, embora a IA seja uma ferramenta poderosa, ela não possui capacidade para interações terapêuticas ou de aconselhamento profundo.

Em entrevista para o Tecmundo, o psicólogo Julio Peres sugere que, ao reforçar a ideia de que uma IA não é uma entidade humana, podemos reduzir possíveis vínculos emocionais com a tecnologia.

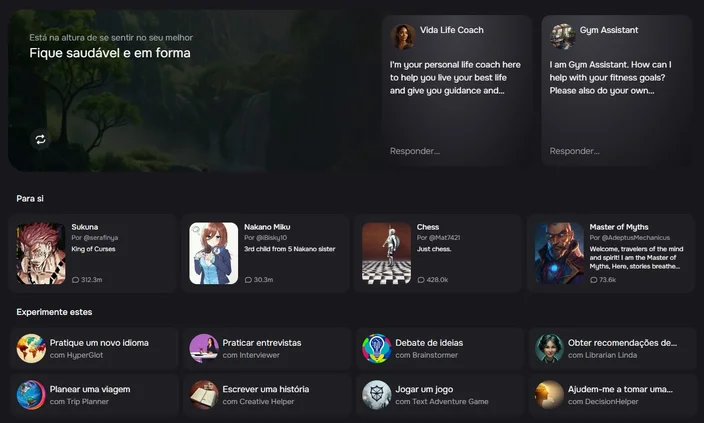

A Character.AI, que possui inúmeros chatbots, precisaria reforçar barreiras para proteger usuários vulneráveis, regulando também o conteúdo e o tempo de uso.

Casos como o de Sewell mostram que as empresas de tecnologia têm a responsabilidade de incorporar mecanismos de segurança, especialmente para menores. IAs como a Character.AI foram desenvolvidas para entretenimento e socialização online, mas seu uso inadequado pode levar a danos emocionais.

Em resposta ao incidente, a Character.AI revisou medidas de segurança, limitando conteúdo sensível para menores e alertando usuários após longas sessões de uso.

Prevenção, suporte e reflexão

O caso da morte de adolescente por uso de inteligência artificial ressalta a importância de supervisão e diálogos constantes sobre saúde mental, especialmente em contextos digitais. Iniciativas como o Centro de Valorização da Vida (CVV) no Brasil fornecem suporte emocional gratuito e sigiloso para quem precisa, disponível 24 horas por dia pelo número 188 e também no site.

Esses incidentes reforçam a necessidade de equilíbrio entre a evolução tecnológica e o bem-estar emocional, exigindo uma responsabilidade compartilhada entre empresas, educadores, pais e os próprios usuários.